穿越之无敌俏公主最新章节列表_穿越之无敌俏公主全文阅读_妖妖中文

itomcoil 2025-10-27 15:00 40 浏览

中新网客户端北京7月日电(记者 上官云)“还有什么可说的,我不过活一日是一日,活一刻是一刻了。我知道,我横竖活不了三五天,我就好回去了。”版《红楼梦》里,当晴雯说完这番话时,宝玉已经哭得泣不成声。

晴雯是《红楼梦》的重要人物。有人认为,晴雯是无辜屈死;有人说她是职场人的反面教材,落得这个下场完全是“作”……她的去世,也一直是个争论许久的话题,至今未息。

一个拥有“核心竞争力”的丫鬟

在怡红院几个出镜率高的丫鬟里,晴雯无疑是亮眼的那一个。

她是大家公认的美人,书里没有正面描述过她的样貌,但从别人的评价中也能有个大概印象,"水蛇腰,削肩膀,眉眼又有些像林妹妹","这些丫头们,共总比起来,都没晴雯生得好"。

晴雯缝补雀金裘。图片来源:版《红楼梦》视频截图

晴雯也手巧。《红楼梦》里有个令人难忘的故事,就是“勇晴雯病补雀金裘”。有一年过节赶上下雪,贾母心疼宝玉,把一件十分珍贵的孔雀毛大氅给了他,结果宝玉没留神,把这么珍贵的衣服烧出一个小洞。

麝月叫人拿衣服出去修补,但工匠都无能为力,一群人正不知道怎么办好,病中的晴雯怕宝玉着急,强撑着揽下这个活计,花了几乎一夜时间将衣服补好,完美还原。

所以,公认审美水平出众的贾母评价过晴雯,“我的意思这些丫头的模样爽利言谈针线多不及她,将来只她还可以给宝玉使唤。”

《醉里挑灯看红楼》作者、专栏作家刘晓蕾说,如果用职场上的话来讲,在怡红院里,晴雯是个拥有“核心竞争力”的人。她颜值高、心灵手巧,还有贾母的认可,前途一片光明。

开启“怼人模式”的晴雯

但这个前途并没有光明许久。生活中,晴雯不算一个低调温和的人,平儿就说“晴雯那蹄子是块爆炭”。惹了晴雯,十有八九会被怼得目瞪口呆。

因为办事爽利,怡红院的丫头小红得到王熙凤的赏识,被叫去传话送荷包。晴雯以为她是去闲逛,小红分辩,被晴雯一阵教训:“怪道呢!原来爬上高枝儿去了,把我们不放在眼里。”

晴雯斥责小丫鬟坠儿。图片来源:版《红楼梦》视频截图

对待犯错的小丫鬟,晴雯更不手软。坠儿偷了平儿的虾须镯,晴雯得知后,拿起一丈青就去戳她的手,疼得坠儿乱喊,还当即就要叫人来,把坠儿赶出去。

“怼人”似乎成了晴雯的一大特点。比如看到宝玉给麝月篦头,便冷笑道,“交杯盏儿还没吃呢,就上头了”;吃醋袭人把自己和宝玉说成是“我们”,又开启讽刺模式,“正经明公正道的,连个姑娘还没挣上去呢,也不过和我似的,那里就称起‘我们’来了!”

她连上级宝玉都没放过:有一回宝玉心情不好,说了她几句,便反击道,“二爷近来气大的很,行动就给脸子瞧……要嫌我们就打发我们,再挑好的使。好离好散的,倒不好?”

所以,有不少读者觉得,晴雯对其他女孩过于尖刻;连宝玉都要顶撞——同事上级得罪了一个遍,跟她相处,别人压力实在太大,一不小心碰就到地雷区。

抱屈而亡的俏丫鬟

果然,晴雯因为结怨太多,在“抄检大观园”时无辜躺枪,最后成了怡红院有名有姓的丫鬟中,第一个离开人世的。

发现绣春囊后,王夫人大惊失色之下,决心要把大观园查个遍才放心。此事负责人之一王善保家的趁机告了晴雯一状,说她“妖妖趫趫,大不成个体统”。

一席话顿时勾起王夫人的心事。她也想起曾经看到过一个“削肩膀水蛇腰,眉眼有些像林妹妹”的标致姑娘,在骂小丫头,模样十分张狂。当即便命小丫头把晴雯叫来。

结果一见面,王夫人更讨厌晴雯,说她一副病西施的模样,唯恐带坏宝玉。当晚便命王熙凤等人雷厉风行开始抄检大观园。在怡红院,晴雯仍不改犀利个性,把箱子倒了个底朝天,当众让王善保家的吃了个没趣。

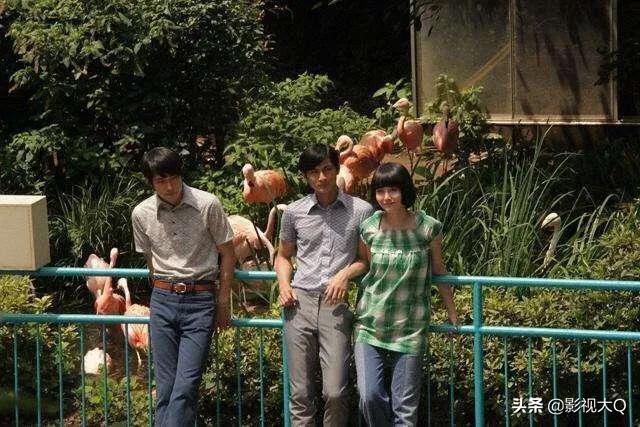

宝玉探望病重的晴雯。图片来源:版《红楼梦》视频截图

没过几天,正在病中的晴雯就被王夫人赶出了大观园,回到哥哥家里,医疗水平和生活待遇下降了不止一个档次,很快,在宝玉探望过她之后,晴雯就离开人世,死前叫了一夜的“娘”。

《红楼梦》,所有“不死之人”的挽歌

自《红楼梦》诞生以来,“晴雯之死”就是个讨论不休的话题。有人说,晴雯是冤屈的,无辜被赶走后病情加重去世;也有人说,是因为她的性格缺陷,完全是“作”的后遗症。

但刘晓蕾并不觉得晴雯“作”,“她性格确实有弱点,但这不是原则性问题,更不能成为导致她最后悲惨命运的原因”。

“晴雯心性单纯,她做的一些事情,要回到当时所处的环境。宝玉对女孩子都很体贴,甚至有时恨不得反过来为她们服务,怡红院更像是一个家庭。”刘晓蕾解释。

所以,刘晓蕾认为,晴雯也有这样的感受,她单纯到完全没把怡红院当成一个“职场”,和同伴乃至宝玉的小争执,都只是类似“拌嘴”,不是太严重的问题。

晴雯的悲剧,是多重合力导致的。刘晓蕾说,王善保家的和王夫人有一个根深蒂固的观念,认为“甚美者必有甚恶”,这并不对。如果晴雯生活在一个尊重生命多元的环境中,也许不会是最后悲惨的结果。

晴雯撕扇。图片来源:版《红楼梦》视频截图

每个人心中都有一部《红楼梦》。或许,对晴雯乃至其他人身上的谜团,讨论永远无法消弭。这就是经典的意义,常说常新,历久弥新。

晴雯的死,是“千红一哭”悲剧的开始。刘晓蕾说,《红楼梦》里写了很多美好的女孩,宝玉曾评价过“雪地抽柴”故事里的女孩茗玉:这样的人是虽死而不死的。晴雯,也是如此。(完)

相关推荐

- 最近中文字幕2019免费(最近中文字幕2019免费版日本解锁版)

-

1女尸谜案,又叫尸物招领,结局你绝对想不到,编剧是神2孤儿,(孤儿怨)这个简直是神作3婚纱,讲母女亲情的,超级感人,哭了一筐纸4告白,日本电影,通过几个人的自诉构成电影。拍摄的手法很特别5被嫌...

- 首席医官曾毅大婚(首席医官曾毅大婚在线阅读)

-

首席医官曾毅的女朋友是高官之女龙美心。曾毅凭着祖传绝技和中西医兼修学养,在高手如林的医学界脱颖而出,仅用三副中药便解除了省委书记夫人的病根,备受青睐,被破格聘请为省医疗保健专家组专家。上任后,他大显...

- 林阳苏颜刚刚更新最新章(林阳苏颜刚刚更新章节全文阅读)

-

林阳苏颜免费阅读小说叫《女神的超级赘婿》,该小说简介:江城市中医院门口。“人还没到吗?”林阳左右扫视了下,继而伸手朝口袋掏了掏,摸出一包七块钱的红金圣,点上猛抽了两口,刚吐出烟雾来,后面便响起了一阵急...

- 火影忍者佐助鸣人(火影忍者佐助鸣人CP图)

-

第四次忍界大战结束后,佐助宣称自己要发动“革命”,并扬言要将现任五影处决,接着使用幻术和地爆天星封印了九大尾兽。鸣人决定出面制止佐助,两人前往终末之谷展开宿命之战。二人对待和平的方式不同,所以佐助否认...

- 重生之女王崛起紫魂(重生之女王崛起 小说)

-

不知道你现在还想不想知道,刚看完,最后和慕离在一起,龙伊死了,那个郁啥的也死了,都是被身边的女的害死的,作者说这是个这样的时代。。。

- 司行霈顾轻舟无删减(司行霈,顾轻舟)

-

《夫人别躲了》是一部由晋江文学城作家秦淮写的现代言情小说,讲述了女主角顾轻舟在一次车祸中失去了记忆,被男主角沈浪收养后,两人之间逐渐产生感情,但因为顾轻舟的身世问题,两人之间的关系面临着种种考验和挑战...

- 元尊小说在线(元尊小说在线阅读)

-

1如下:-第一章乱舞霓裳-第二章中天品阶-第三章神火天尊-第四章泰清道统-第五章清风益气-第六章望河仙人-第...

- 天才高手txt下载八零电子书(天才高手小说下载 下载)

-

这本书语言简单,明了。条理清晰明确,伏笔深沉有度。不错、不错。才高手:内容简介:这是一个兵王的故事,这是一个高手的故事,这更是一个天才和美人的故事,扮扮猪,吃吃虎,唱唱歌,泡泡妞,弹弹琴,杀杀敌人,...

- 永恒国度之秘密花园三部曲(《永恒国度之秘密花园》)

-

3部正传。~~2部番外。分别是1永恒国度之秘密花园2永恒国度之暗黑黎明3永恒国度之封魔印章番外永恒国度秘传之惊伦六日永恒国度之喋血鸳鸯~一共有30个,分别是:蔡琰,邀月,怜星,聂小...

- 云之羽电视剧免费播放(《云之羽》免费观看)

-

不播放。1.《云之羽》是一部电影,电影通常在电影院上映,而不是在星期天播放。因此,按照+的,可以得出是不播放。2.电影院通常会在周末或者其他时间段上映电影,而具体电影的播放时间和排片安排是需要参考...

- 麻衣神婿陈黄皮最新全文(麻衣神婿陈黄皮最新章节列表)

-

陈黄皮最后按照婚约去叶家迎娶叶红鱼,却被叶家退婚。因为青麻鬼手死了,陈黄皮对叶家便毫无用处了。可是他们不知道陈黄皮早已经尽得他爷爷的真传,来到大城市的陈黄皮凭借一手风水奇术,走上人生巅峰。跟陈元方一起...

- 和哺乳期同事不带套(哺乳期同房没有戴套怎么补救)

-

哺乳期保护的是公司不能无故辞退,要看你请的是什么假,如果是哺乳假,法定的每天有一个小时,不准他违法。如果是别的假,要看具体情况和公司规章制度。总之保护该保护的,但不是护身符。

- 长在面包树上的女人电视剧(长在面包树上的女人电视剧剧情简介)

-

一直向往上海生活的程韵作为交换生成为了上海某知名大学的学生,带着未考上大学的迪之与上海本地的光蕙见面并成为最好的朋友,三人彼此交流着自己的心事。光蕙看到叔叔对生病卧床的婶婶关怀备至,这种不离不弃的爱让...

- 重生大唐贞观成才子(重生之大唐贞观第一纨绔)

-

小说作者:秦怀道李丽仙小说内容:穿越大唐贞观年间,成为了秦琼之子秦怀道,觉醒了神级选择系统。李二:秦怀道这个混蛋,你到底选择娶朕的长乐还是小兕子?秦怀道:小孩子才做选择,当然是全都要了。长乐、兕子:父...

- 一周热门

- 最近发表

- 标签列表

-